LLM 뛰어넘어 대규모 멀티모달 모델(LMM) 경쟁으로 진화

이미지, 영상, 음성, 제스처 등 데이터 추론, ‘이미지’ 등 결과물 생성

글로벌 빅테크들 ‘제미니’, ‘소라’, ‘클로드’, ‘키프레이머’, ‘타이탄 제너레이터’ 등

[애플경제 전윤미 기자] ‘생성AI’ 개발 경쟁이 2024년에는 ‘멀티모달(Multi Modal)AI’로 확전될 가능성이 크다. 이는 모달리티 간 정보를 교환·활용, 시너지를 창출하므로, 이에 대한 관심이 특히 높아지면서 본격적인 멀티모달 AI 경쟁이 전개될 전망이다.

그래서 “생성AI의 대규모 언어 모델(LLM) 개발 경쟁은 이제 대규모 멀티모달 모델(LMM: Large Multimodal Model) 개발 경쟁으로 진화할 것”이란 예상도 많이 나오고 있다.

AI가상비서, 의료, 쇼핑, 교육, 학습도구, 자율주행 등 적용

텍스트 분석에 기반을 둔 LLM과 달리 ‘LMM’은 이미지, 영상, 음성, 제스처 등 복잡한 데이터를 분석하고 추론하는 것이 특징이다.

정보통신기획평가원은 최근 리포트를 통해 “맥주와 물병 등이 놓인 테이블 사진과 메뉴판을 함께 제시하면 식당에서 밥값을 계산할 수 있고, 엑스레이와 컴퓨터단층촬영 사진을 보고 골절 부위 등 질병을 진단할 수도 있다”고 예를 들기도 했다.

이는 또 기하 문제 등을 촬영한 뒤 문제 풀이나 오답 체크를 할 수도 있고, 보고서 작성을 위한 숫자 데이터 그래픽화나 트렌드 분석도 할 수 있다. 음성으로 통역을 하거나, 제품의 소리나 이미지를 분석해 불량률을 파악하기도 한다.

또한 AI가상 비서, 의료, 쇼핑, 교육, 학습 보조 도구, 자율주행 등 다양한 영역에서 활용할 수 있다. 이미지와 비디오, 오디오 등 반응 데이터 종류가 확장될수록 활용도가 높아지고 있다. “나아가선 추론 데이터로 활용할 수 있도록, 멀티모달 AI와 로봇 공학이 결합, 사람에 더 가까워진 AI로 진화할 것”으로 전망되기도 한다.

그런 만큼 글로벌 빅테크를 비롯한 기업들은 시장 주도권 확보를 위해 치열한 경쟁을 벌이고 있다.

오픈AI, 텍스트-비디어 모델 ‘소라’

대표적으로 ‘오픈AI’는 간단한 텍스트를 입력하면 최대 1분 분량의 영상으로 구현하는 ‘텍스트 투 비디오(Text to Video)’ 모델 ‘소라(Sora)’를 최근 출시했다. 이는 사용자가 입력한 프롬프트(명령어)를 정확하게 해석하고 이를 영상으로 표현할 수 있도록 ‘이미지 생성 AI’인 ‘달리3’에 적용된 시각 훈련 데이터를 활용, 언어 이해도를 향상시킨 것이다.

또한, 초거대언어모델이 텍스트를 컴퓨터가 이해할 수 있는 단위인 토큰으로 쪼개 처리하듯, 영상과 이미지를 패치(Patch)라는 단위로 쪼개어 처리한다. 데이터 학습을 통해 여러 캐릭터, 특정 유형의 동작, 피사체와 배경의 정확한 세부 묘사를 통해 복잡한 장면을 생성하기도 한다.

앤트로픽, 3가지 버전의 ‘클로드3’

‘앤트로픽’은 학습량에 따라 오푸스(Opus)와 소네트(Sonnet), 하이쿠(Haiku) 등 3가지 버전으로 구성된 생성형 AI 모델 ‘클로드3(Claude 3)’를 공개했다. 그 중 클로드3 오푸스는 앤트로픽이 내놓은 첫 멀티모달 생성형 AI다. 이는 사용자가 사진, 차트, 문서 및 기타 유형의 데이터를 업로드하고, 이에 대한 분석 및 답변을 얻을 수 있도록 했다.

다만 윤리적 및 법적 문제 때문에 사람과 관련된 이미지를 식별할 수 없도록 만들어졌다. 또한 한 번의 요청으로 최대 20개까지 여러 이미지를 분석할 수 있다.

앤스로픽은 “‘오푸스’는 학부 수준 지식과 대학원 수준의 추론, 기본 수학 능력을 갖췄으며, 업계 벤치마크 테스트에서 오픈AI ‘GPT-4’와 구글 ‘제미니 울트라’를 능가했다”고 소개했다. 다만 제미니나 GPT-4와 같이 이미지 생성 서비스는 지원하지 않으며, 2023년 8월 이전의 데이터로만 질문에 답할 수 있고 웹 검색도 불가능하다.

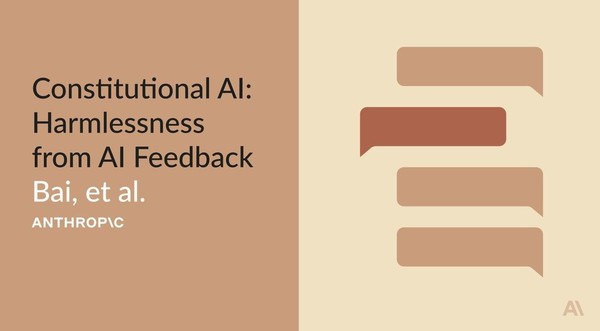

구글, ‘제미니1.0’ 이어 ‘1.5프로’

‘구글’도 자체 개발한 멀티모달 인공지능 모델 ‘제미니 1.5 프로(Gemini 1.5 Pro)’를 지난 2월 발표했다. 또 생성AI 비디오 모델 ‘루미에르(Lumiere)’도 공개했다.

‘제미니 1.5 프로’는 구글의 최신 AI 모델인 ‘제미니 1.0 울트라’와 비슷한 수준이다. 텍스트·이미지·음성·영상을 생성하는 멀티모달 모델이며, 최대 100만 개의 토큰 처리 능력을 갖췄다. 기존 1.0 프로가 수행하는 3만 200개의 토큰 처리 규모를 크게 뛰어넘은 것이 특징이다.

AI 모델이 한 번에 처리할 수 있는 정보의 양을 ‘콘텍스트 윈도(context window)’라고 하는데, 이는 단어·이미지·영상·오디오·코드 등의 의미가 있는 ‘토큰(token)’이라는 단위로 구성된다. ‘제미니 1.5 프로’는 1시간 분량의 동영상과 11시간 분량의 음성 파일, 3만 줄 이상의 코드, 70만 단어 이상의 텍스트에 해당하는 방대한 정보를 한 번에 처리할 수 있다. 또한 400페이지가 넘는 분량의 아폴로 11호 달 탐사 임무 관련 문서를 주면, 문서 전체 내용과 이미지, 세부 정보를 추론할 수도 있다.

그러나 사실과 맞지 않는 이미지를 생성하면서 정확성과 품질 오류로 인해 서비스를 중단했다. 예를 들어 미국 건국의 아버지(Founding Fathers) 같은 역사적인 인물을 유색 인종으로 그렸고 ‘1943년 독일군’을 그리라는 프롬프트(명령어)에 흑인과 아시아인 이미지를 생성하기도 했다. 구글이 바드(제미니)를 공개(2023.2월)했을 때처럼 오류를 반복하면서 신뢰도가 하락한 것이다.

한편 구글은 간단한 명령어를 영상으로 만들어 주고, 영상 속의 옷을 원하는 대로 바꿔주는 생성 AI 비디오 모델 ‘루미에르(Lumiere)’도 공개했다. 루미에르 출시 시기는 아직 미정이며, 현재는 결과물 예시와 개념을 소개한 논문이 깃허브에 공개된 상태다.

‘루미에르’는 텍스트 프롬프트를 비디오로 변환하는 것은 물론, 이미지의 가려진 부분까지 비디오로 구현해 내거나, 특정 영역에 애니메이션 효과도 넣을 수 있는 점이 특징이다.

메타, 이미지 생성 도구 ‘에뮤 비디오’

‘메타’도 이미지 생성 도구 ‘에뮤 비디오(Emu Video)’를 지난해 11월 공개했다. 이는 이미지를 넣으면 4초 길이의 애니메이션 영상을 만들어 준다.

에뮤 비디오는 에뮤 에딧(Emu Edit)이라는 AI 모델을 사용, 편집하는 방식이다. 텍스트를 입력하면 그림을 그려주며, 지시에 맞춰서 그림이 움직이기도 한다. 이는 또 2개의 확산 모델을 사용해 초당 16프레임으로 512x512 4초 비디오를 생성, 메타의 이전 비디오 생성 도구인 ‘메이커비디오(Make-A-Video)’보다 더 간단하게 만들 수 있다.

애플, AI툴 ‘키프레이머’ 비공개 테스트 중

‘애플’도 뒤늦게 ‘AI경쟁’에 나섰다. 이 회사는 인공지능을 활용해 정지 이미지를 애니메이션으로 바꿔주는 AI툴 ‘키프레이머(Keyframer)’에 대한 연구 결과를 아카이브(arXiv)에 공개(2.15)했다. 또 이미지 분석이나 답변에 특화된 ‘페럿(Ferret)’을 오는 연말까지 개발할 것으로 알려졌다.

‘키프레이머’는 오픈AI의 GPT4 모델을 기반으로 한 것이다. 사용자들은 코딩 지식 없이도 SVG 이미지 파일과 프롬프트를 통해 쉽게 제작할 수 있다. 아직 공개적으로 출시되지 않았으며 테스트도 비공개로 진행 중이다.

‘페럿’은 80GB 메모리를 갖춘 8개의 A100 GPU에서 훈련되었다. 이미지 분석 및 답변에 특화되어 사용자가 동물 이미지를 강조해 표시하고, 동물 종을 질문하면 이를 식별하고 답변할 수 있다.

아마존, ‘타이탄 이미지 제네레이터’

‘아마존’도 타이탄 멀티모달 파운데이션 모델에 기반한 ‘타이탄 이미지 제네레이터(Titan Image Generator)’를 지난해 11월 공개했다. 이는 아마존의 AI 개발 플랫폼인 ‘베드록’(Bedrock)에서 AWS 고객을 위한 ‘미리 보기’로 제공되고 있다. 사용자는 자연어를 사용하여 이미지를 생성하고 편집도 할 수 있다.

((2-②)에 계속)